Bisher haben wir in dieser Reihe über die KI-Steuerungsebene festgestellt, dass MCP der Katalysator für den Wandel der KI vom Berater zum Akteur ist (Teil 1). Anschließend haben wir die sieben Ausführungsprimitive definiert, die für eine produktionsreife KI-Steuerungsebene erforderlich sind (Teil 2), und das Betriebsmodell detailliert beschrieben, das für eine chaotische Skalierung von Agenten erforderlich ist (Teil 3).

Nun gehen wir vom Aufbau der Steuerungsebene zum Vertrauen in diese über.

Sie haben die Phase „Agenten sind cool“ hinter sich gelassen. Sie haben einen Agenten entwickelt, der echte Aktionen ausführen kann . Vielleicht kann er Zugriffsrechte vergeben, Abrechnungsprobleme lösen oder Vorfälle beheben. Die Fragen haben sich nun von „Kann ein Agent eine Verbindung zu Tools herstellen?“ zu „

- In welcher Funktion handelt dieser Agent?

- Was darf der Agent berühren?

- Wer hat die Maßnahme genehmigt?

- Was hat sich geändert?

- Und wie können wir das (schnell) beweisen, wenn etwas schiefgeht?

Die Beantwortung dieser Fragen bildet die Grundlage für das Vertrauensgefüge. Ohne dieses Vertrauensgefüge ist die Grenze zwischen einem agentenbasierten Unternehmen und einem Sicherheitsvorfall gefährlich dünn.

Agenten stellen traditionelle Identitätsverwaltung in Unternehmen infrage

Unternehmen haben Modelle für die Steuerung von Menschen (Manager, Rollen) und Dienstleistungen (Dienstleistungsprinzipien, Bereiche) etabliert. Agenten sind weder das eine noch das andere. Sie sind eine neue Klasse von Akteuren: probabilistische Entscheidungsfindung, die auf deterministischen Aufzeichnungssystemen aufbaut.

Sie arbeiten über traditionelle Grenzen hinweg: Geschäftsanwendungen, Identitätssysteme, Datenplattformen und Infrastruktur. Wenn Sie einen Agenten als „nur eine weitere Integration“ betrachten, erhalten Sie das klassische Muster für Unternehmensfehler: weit verbreitete gemeinsame Anmeldedaten, inkonsistente Protokollierung und ein Audit-Trail, der im Wesentlichen eine Sammlung von Meinungen ist.

Die Ironie dabei ist, dass die zugrunde liegenden Systeme reguliert sind. Es ist die Kompositionsschicht, die zum Schwachpunkt wird.

Konzentrieren Sie sich auf die Autorisierungsfunktionen statt auf die Tools.

Bei den meisten frühen Implementierungen wird der Fehler gemacht, die Steuerung auf der Ebene der Tools und Endpunkte vorzunehmen: „Dieser Agent kann Salesforce aufrufen, dieser kann Jira aufrufen.“ Dies führt zu einer unübersichtlichen Vielzahl von Richtlinien, die nicht skalierbar sind, was folgende Folgen hat:

- Hunderte von unterschiedlichen Werkzeugen

- Inkonsistente Authentifizierungsmodelle und Anmeldedaten

- Fragile Grenzfälle und Fragmentierung der Politik

Die Einheit, die für das Unternehmen von Bedeutung ist, ist die Geschäftsfähigkeit. Auf dieser Ebene muss die KI-Steuerungsebene die Governance durchsetzen.

Beispiele für Fähigkeiten (Absicht + Leitplanken):

- BereitstellungMitarbeiterZugang

- Fehler bei der Rechnungsstellung beheben

- Vorfall mit Leitplanken schließen

- Datensatz mit Steuerelementen exportieren

Fähigkeiten kodieren sowohl Absichten als auch Leitplanken: Welche Aktionen sind enthalten, welche Systeme können berührt werden, was muss validiert werden, welche Genehmigungen werden eingeholt und welche Daten müssen maskiert werden? An dieser Stelle geht die Integration von der technischen Umsetzung zur Governance für die Ausführung über.

Schaffung von Überprüfbarkeit mit dem Entscheidungsprotokoll

Wenn ein Vorfall auftritt, erwarten ausgereifte IT-Systeme, dass Sie die Anfrage rekonstruieren, die Handlungskette überprüfen und nachweisen, dass sie autorisiert und genehmigt wurde. Bei der agentenbasierten Ausführung ist die bloße Protokollierung „Der Agent hat mit X geantwortet” lediglich eine Abschrift, keine Aufzeichnung.

Die agentenbasierte Ausführung erfordert eine Protokollierung der Gründe, warum sie zugelassen wurde. Ein echter Entscheidungsdatensatz muss Folgendes enthalten:

- Identität: Wer hat die Aktion angefordert (Mensch, Agent und Kontext „im Namen von“)?

- Fähigkeit: Welche Fähigkeit und Version wurde aufgerufen?

- Richtlinienbewertung: Ergebnisse , die zeigen, welche Regeln ausgelöst und welche Einschränkungen angewendet wurden

- Nachweis: Genehmigungen gesammelt (z. B. Schwellenwert überschritten, SoD-Regeln erfüllt)

- Rückverfolgbarkeit: Korrelations-IDs über nachgelagerte Systeme hinweg (Ticket-IDs, Transaktions-IDs)

- Ergebnis: Endergebnisse und etwaige Ausgleichsmaßnahmen (Rollback, Eskalation)

Ohne klare Verantwortlichkeiten für das Verhalten des Modells reicht eine einfache Aussage wie „das Modell hat entschieden“ nicht aus, um die für die Überprüfung von Vorfällen erforderliche Überprüfbarkeit zu gewährleisten.

Nehmen Sie Reibung für eine effektive Kontrolle in Kauf

Unternehmen optimieren häufig für eine reibungslose Ausführung genau an den Stellen, an denen Reibung eine notwendige Kontrollmaßnahme darstellt:

- Aktionen der Stufe 0/1 (schreibgeschützte, rückgängig machbare Entwürfe) sollten schnell sein.

- Maßnahmen der Stufen 2/3 (Geld, Zugriff, Produktion, regulierte Daten) erfordern eine verstärkte Kontrolle: Genehmigungen, Aufgabentrennung, deterministische Orchestrierung und unveränderliche Protokollierung.

Der Human-in-the-Loop muss ein festgelegter Schritt sein, kein Panikknopf. Entscheidend ist, dass eine Tier-2/3-Aktion, die nicht über den festgelegten Pfad abgeschlossen werden kann, auf einen festgelegten menschlichen Workflow zurückgeführt werden muss und nicht auf einen anderen Werkzeugpfad. Improvisation führt zu unbeabsichtigten Rückerstattungen, falschen Zugriffsberechtigungen und unbegrenzten Wiederholungsversuchen.

Praktische Beispiele für Vertrauen in der Produktion

Die Arbeitsabläufe in der Praxis zeigen, dass Vertrauen nicht auf Theorie basiert, sondern auf einer dokumentierten Abfolge von Kontrollen und Rechenschaftspflichten.

Zugriffsbereitstellung

- Agent ruft ProvisionEmployeeAccess auf ⇒

- Richtlinienprüfungen ⇒

- Genehmigung durch den Manager ⇒

- Deterministischer Workflow aktualisiert Identitätssystem ⇒

- Entscheidungsprotokoll erfasst genaue Änderungen + Ticketverknüpfung

Rückerstattungen oder Gutschriften

- Agent ruft ResolveBillingIssue auf ⇒

- Schwellenwertpolitik + Betrugsüberprüfungen ⇒

- Genehmigung über X $ ⇒

- Idempotente Ausführung im Abrechnungssystem ⇒

- Die Entscheidungsaufzeichnung enthält das Beweismaterial und die genaue Transaktion.

Behebung von Vorfällen

- Agent ruft CloseIncidentWithGuardrails auf ⇒

- Runbook-Gating + Überprüfung des Einfrierfensters ⇒

- Deterministische Ausführung mit begrenzten Wiederholungsversuchen ⇒

- Durchgängige Rückverfolgbarkeit über ITSM und Infrastruktur hinweg

Vertrauen ist eine architektonische Entscheidung.

Vertrauen ist keine philosophische Debatte. Es ist die Fähigkeit, die Frage zu beantworten: Wer hat was getan, warum und unter welcher Autorität? Ohne diese Klarheit kann echte Unternehmensautonomie nicht erreicht werden.

Die größte Herausforderung für Unternehmen ist nicht die Handlungsfähigkeit der Agenten, sondern die Fähigkeit der Organisation, diese Handlungen zu absorbieren, ohne dabei die Kontrolle, Sicherheit oder Stabilität zu verlieren. Die Zukunft der Unternehmens-KI erfordert die Etablierung eines einzigen, vertretbaren Standards für eine KI-Kontrollebene. Dadurch wird die Autonomie der Agenten von einem Risiko zu einem skalierbaren, überprüfbaren Vermögenswert. Wenn die Ausführung kostengünstig ist, wird die Koordination zum wichtigsten Vermögenswert, und genau dieses grundlegende Problem löst die Kontrollebene.

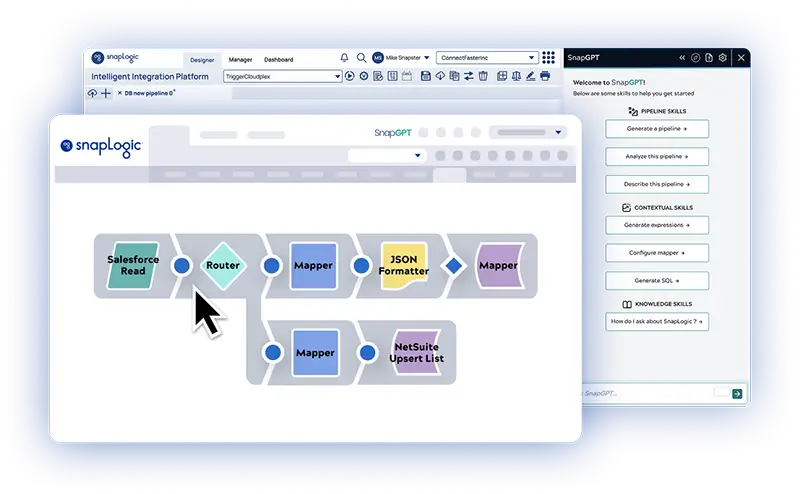

Die Unternehmen, die diese Koordination beherrschen, werden Agenten in großem Maßstab einsetzen. Wenn Sie bereit sind, über Demos hinauszugehen und Autonomie durch vertretbare Wege aufzubauen, erfahren Sie mehr über Agentic Integration und fordern Sie noch heute eine Demo an, um die KI-Steuerungsebene in Aktion zu sehen.

Entdecken Sie die AI-Steuerungsebene-Serie

Teil 1: Middleware ist die neue Steuerungsebene für KI

Verstehen Sie, wie MCP die Unternehmensarchitektur neu gestaltet und die Distanz zwischen Absicht und Handlung überbrückt.

Teil 2: Wie eine echte KI-Steuerungsebene aussieht, bevor es zu einer MCP-Ausbreitung kommt

Lernen Sie die Ausführungsprimitive, Governance und Überwachung kennen, die dafür sorgen, dass autonome Systeme sicher und vorhersehbar laufen.

Teil 3: Wie man die KI-Steuerungsebene betreibt, ohne dass Autonomie zu Chaos führt

Dieser Beitrag bietet ein praktisches Betriebsmodell für die Skalierung von KI-Agenten, das Risikomanagement und den Aufbau von Vertrauen in der Produktion.

Teil 4: Vertrauen sichtbar machen: Die Grundlage für die Skalierbarkeit von Agenten

Wie man durch Fähigkeiten, überprüfbare Entscheidungsprotokolle und mehrstufige Kontrollen ein Vertrauensgefüge aufbaut, um KI-Agenten im Unternehmen sicher zu steuern.

Teil 5: Die Governance-Engine: Wie Unternehmen die Kontrolle über agentenbasierte KI behalten

Erfahren Sie mehr über den Aufbau eines skalierbaren Governance-Systems und eines Funktionskatalogs, um die Kontrolle, Überprüfbarkeit und Langlebigkeit autonomer KI-Agenten zu gewährleisten.

Teil 6: Die Einführung im Unternehmen: Hybride Ausführung und der Weg zu operativer KI

Verstehen Sie den Migrationspfad und das Architekturmuster einer zentralisierten Governance mit verteilter Ausführung, um operative KI in hybriden Unternehmensumgebungen zu erreichen.