Nous avons désormais établi le plan architectural (parties 1 et 2), le modèle opérationnel (partie 3) et le principe fondamental de maîtrise de la variabilité (partie 4). Le prochain défi est d'ordre organisationnel : veiller à ce que la vitesse et l'autonomie des agents n'entraînent pas une perte de contrôle, une explosion des risques ou un incident de production auto-infligé. L'intelligence sans coordination est instable.

Cette partie de la conversation porte sur la mise en place d'un système de gouvernance évolutif qui codifie ce qui est « autorisé à être exécuté », faisant ainsi du chemin de moindre résistance le chemin offrant la plus grande sécurité et la meilleure auditabilité. C'est la plateforme qui transforme l'enthousiasme des agents en durabilité pour l'entreprise.

La spirale autodestructrice de l'expansion des agents

Nous avons désormais établi que le passage d'une IA en tant que conseiller à une IA en tant qu'acteur modifie fondamentalement votre architecture. Mais cela entraîne une conséquence prévisible et dangereuse.

Tous les programmes d'agents qui connaissent un succès précoce suivent cette trajectoire commune et autodestructrice :

- Une seule équipe fournit un flux de travail automatisé utile

- D'autres équipes copient l'outil ou l'intégration sous-jacente.

- Un marché pour ces outils émerge au sein de l'organisation.

- Tout le monde se précipite pour publier des outils MCP

- Les capacités dupliquées (avec de légères variations) se multiplient de manière exponentielle.

- Les informations d'identification et les champs d'accès deviennent fragmentés et désorganisés.

- Les appels d'outils incontrôlés augmentent, gonflant les coûts et la charge

- La propriété et la responsabilité de l'exécution sont floues.

- Le premier incident majeur survient à la suite d'une action incontrôlée.

- L'organisation réagit en verrouillant tout, bloquant ainsi l'ensemble du programme.

Cet arc n'est pas une caractéristique de l'IA ; c'est le résultat inévitable d'une mise à l'échelle de l'exécution sans modèle opérationnel. L'entreprise n'a pas besoin de plus d'outils ; elle a besoin d'une gouvernance conçue pour s'adapter à l'échelle. Elle a besoin d'une plateforme il est plus facile et moins coûteux de faire ce qui est juste, sûr et vérifiable que de faire ce qui est mal.

Commencez par le système central d'enregistrement : le catalogue des capacités.

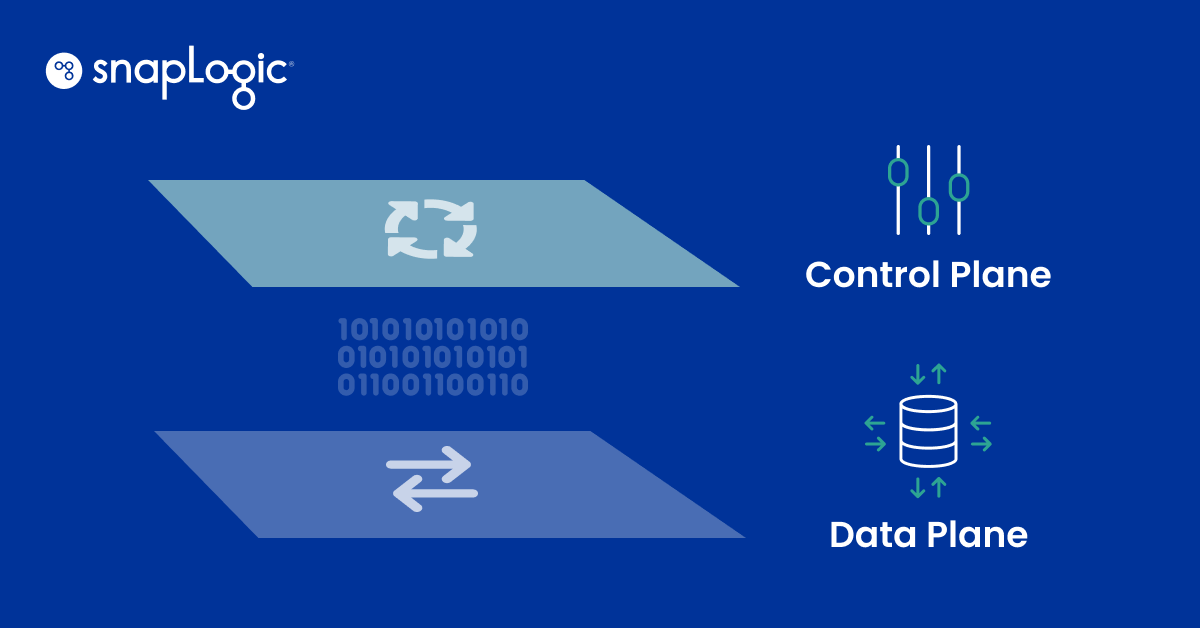

Si vous ne disposez pas d'un catalogue de capacités, vous n'avez pas de plan de contrôle, mais seulement un ensemble d'intégrations non coordonnées. Ce catalogue doit être le système d'enregistrement actif pour toutes les « exécutions autorisées ».

C'est ainsi que vous répondez aux questions les plus cruciales : « Disposons-nous déjà de cela ? » et «Son utilisation est-elle sûre ? »

Un catalogue de qualité production doit appliquer les métadonnées suivantes :

- Nom de la fonctionnalité et objectif commercial : ce que l'entreprise pense qu'il se passe (par exemple, « ProvisionAccess »), et non l'API technique appelée.

- Équipe propriétaire et rotation des permanences : responsabilité claire et obligatoire en matière de maintenance et de panne

- Niveau (0-3) : désignation du niveau de risque qui régit l'application de la politique.

- Systèmes et classes de données concernés : définition explicite du rayon d'action de l'exécution (par exemple, ERP, PII, données réglementées).

- Version et date de dépréciation (obligatoire) : garantir que l'écosystème passe aux nouvelles normes et soit exempt de tout risque lié à l'héritage.

- Politique d'approbation et seuils : définir quand une supervision humaine est nécessaire

- SLO et liens d'observabilité : relier la capacité à sa réalité opérationnelle

Le modèle à plusieurs niveaux pour la certification

Le modèle binaire « expérimental vs production » échoue immédiatement avec les agents, car le risque n'est pas binaire. Le plan de contrôle doit appliquer un modèle de certification à plusieurs niveaux aligné sur le rayon d'impact potentiel :

- Niveau 0 (contexte sécurisé) : récupération en lecture seule, synthèse, masquage strict et validation des résultats (vitesse élevée, risque faible)

- Niveau 1 (réversible) : actions limitées et les workflows déterministes les workflows une traçabilité complète et claire. (Actions pouvant être annulées ou compensées.)

- Niveau 2 (impact élevé) : changements financiers, d'identité ou de production ; nécessite des autorisations centrales, une authentification renforcée, des plans de retour en arrière et des enregistrements de décisions immuables.

- Niveau 3 (réglementé/irréversible) : suppressions, résiliations ou exportation d'ensembles de données réglementés ; nécessite une séparation des tâches, des tests de relecture et une gestion des changements très stricte.

La certification doit être mécanique. Les équipes doivent connaître les exigences exactes pour promouvoir une capacité, en veillant à ce que les contrôles des risques soient appliqués, et non débattus.

FinOps : maîtriser les véritables moteurs des dépenses

La plus grande surprise dans l'exécution agentique est que le coût réel n'est pas lié aux jetons modèles, mais aux retombées opérationnelles d'actions non contrôlées. Le plan de contrôle doit suivre et lutter contre les véritables facteurs de dépenses :

- Diffusion des outils/API : agents non contrôlés effectuant plusieurs appels en aval qui se chevauchent pour une seule intention.

- Réessais et délais d'attente : le facteur d'amplification des réessais doit être suivi, car des réessais illimités pendant une panne peuvent entraîner une augmentation des coûts et une surcharge des systèmes d'enregistrement.

- Charge de travail liée à la vérification humaine : coût des approbations, des exceptions et des escalades, qui peut dépasser le coût de l'automatisation elle-même.

La gouvernance gère le plan de contrôle de l'IA à l'aide d'indicateurs clés, tels que le coût par action régie et le coût par résultat positif. Elle protège le budget contre la volatilité de l'exécution en mettant en place des plafonds de dépenses et des limites basés sur le niveau de capacité.

Chaîne d'approvisionnement et application des mesures

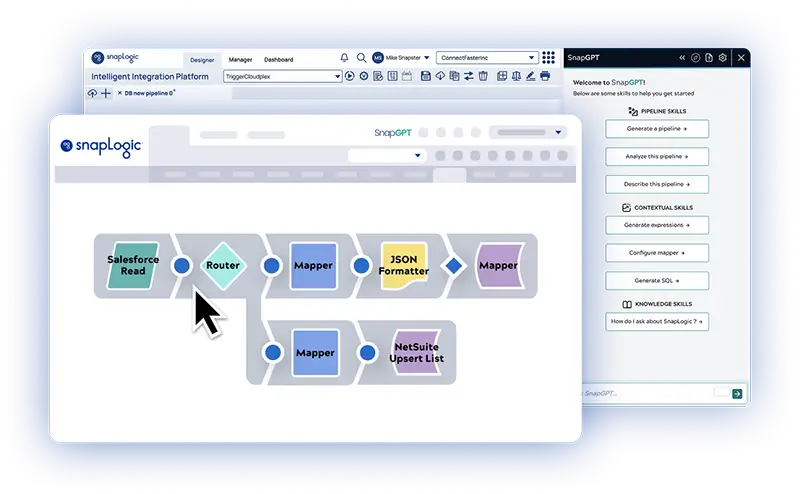

Dans un écosystème d'agents, les serveurs MCP tiers et les fournisseurs deviennent des surfaces d'exécution, modifiant ainsi les résultats. Votre règle doit être la suivante : les agents n'appellent pas les fournisseurs, les agents appellent les capacités.

La logique du fournisseur se situe derrière la limite de capacité, où le plan de contrôle applique les mesures de sécurité et de qualité :

- Validation et schémas

- Politique et autorisations

- Journalisation des audits et modes de défaillance déterministes

- Gestion des versions et obsolescence

Ce cadre constitue le fondement de la règle d'or du plan de contrôle de l'IA : décentraliser la création de capacités, centraliser l'application. La petite plateforme gère les normes de publication, les primitives d'application des politiques, les portes d'accès à la certification et les interrupteurs d'arrêt d'urgence. Cette approche vous permet d'encourager la contribution tout en évitant le chaos.

Réservez une démonstration dès aujourd'hui et commencez à mettre en place une gouvernance adéquate pour gérer la prolifération des agents.

Découvrez la série sur le plan de contrôle IA

Partie 1 : Le middleware est le nouveau plan de contrôle pour l'IA

Comprenez comment le MCP remodèle l'architecture d'entreprise et réduit la distance entre l'intention et l'action.

Partie 2 : À quoi ressemble un véritable plan de contrôle IA avant que le MCP ne commence à se développer

Découvrez les primitives d'exécution, la gouvernance et la supervision qui garantissent le fonctionnement sûr et prévisible des systèmes autonomes.

Partie 3 : Comment exploiter le plan de contrôle IA sans transformer l'autonomie en chaos

Cet article propose un modèle opérationnel pratique pour faire évoluer les agents IA, gérer les risques et instaurer la confiance dans la production.

Partie 4 : Rendre la confiance visible : les fondements de l'

à l'échelle agentique Comment établir une structure de confiance grâce à des capacités, des registres de décisions vérifiables et un contrôle à plusieurs niveaux afin de gérer en toute sécurité les agents IA dans l'entreprise.

Partie 5 : Le moteur de gouvernance : comment les entreprises maintiennent leur contrôle sur l'

de l'IA agentielle Découvrez comment mettre en place un système de gouvernance évolutif et un catalogue de capacités afin de maintenir le contrôle, l'auditabilité et la durabilité des agents IA autonomes.

Partie 6 : Le déploiement dans l'entreprise : exécution hybride et voie vers l'IA opérationnelle

Comprenez le chemin de migration et le modèle architectural de la gouvernance centralisée avec exécution distribuée pour mettre en œuvrel'IA opérationnelle dans les environnements d'entreprise hybrides.